LLM4Rec:当推荐系统遇到大语言模型-腾讯云开发者社区-腾讯云

一段话总结

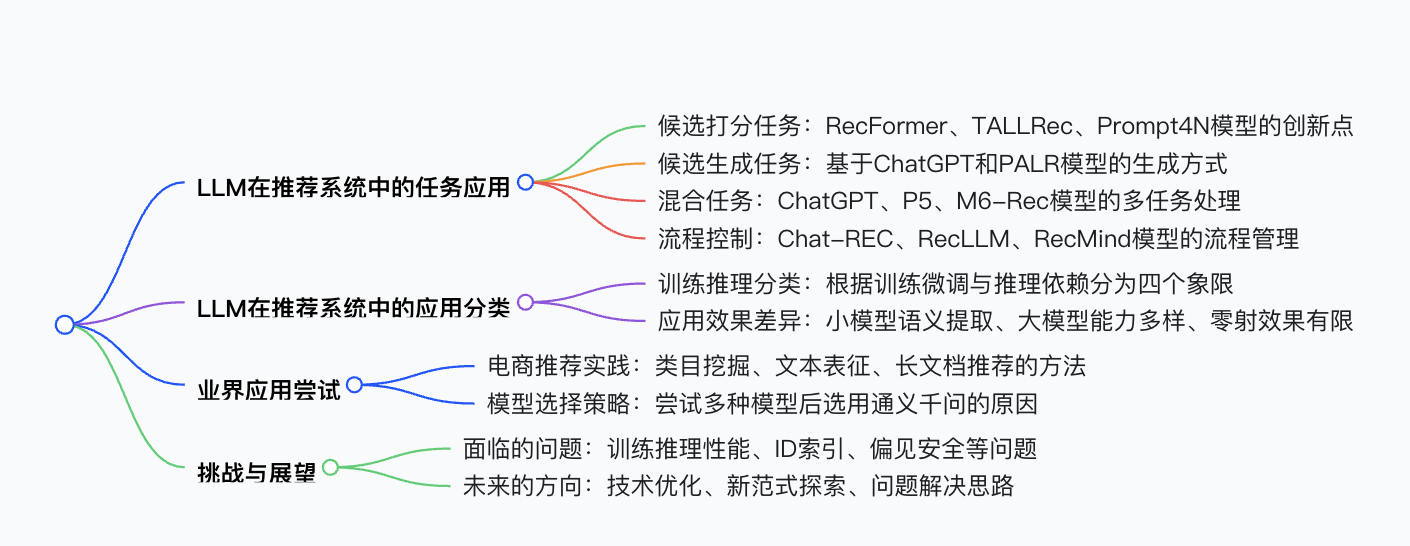

本文聚焦大语言模型在推荐系统中的应用(LLM4Rec),介绍了LLM在候选打分、候选生成、混合任务及流程控制等方面的工作,如RecFormer、TALLRec、ChatGPT-based Generation等模型。从训练和推理阶段将现有工作分为四个象限,并探讨了业界尝试,指出LLM应用面临训练和推理性能、ID索引建模、模型偏见和安全等问题,同时展望了未来发展方向。

详细总结

大语言模型(LLM)在推荐系统中的应用愈发深入,本文从多个方面进行了介绍:

-

LLM在推荐系统中的任务应用

-

候选打分任务:

- RecFormer:亚马逊KDD'23的工作,针对序列推荐冷启动和场景迁移问题,将商品属性转为自然语言句子,构造4种Embedding,用Longformer编码,设置MLM和item对比学习预训练任务,采用两阶段微调 。

- TALLRec:中科大RecSys'23的工作,针对LLM与推荐任务差距大的问题,用推荐数据微调LLM(LLaMA-7B+LoRA),分alpaca-tuning和rec-tuning两步,实验显示AUC最高。

-

Prompt4N:华科SIGIR'23的工作,通过prompt learning将新闻推荐转化为MLM预测任务,设计离散、连续、混合模板衡量推荐目标。

- 候选生成任务:

-

ChatGPT-based Generation:利用LLM的zero-shot能力,将召回商品作为候选,通过prompt传入信息,输出排序商品列表,有按顺序、强调最近交互等prompt方式。

-

PALR:亚马逊的工作,微调LLaMA-7B,设置Recommend和Recommend_Retrieval两种任务,实验显示后者效果更好。

- 混合任务:

-

ChatGPT:通过prompt设计应用于多种推荐任务,在评分预测等任务表现较好,序列推荐等较差。

- P5:统一推荐任务范式,将5大类推荐任务转为自然语言输入,用seq2seq框架预训练,构造特定训练样本,使用whole-word-emb保留个性化特征。

-

M6-Rec:与P5类似,用M6模型,以item文本表征,对性能延迟进行优化,如multi-segment late interaction、模型压缩等。

- 流程控制:

-

Chat-REC:输入用户与物品交互等信息,可调用传统推荐系统接口,实现推荐、解释等功能。

- RecLLM:包含对话管理等模块,用LLM与用户对话、检索物品、生成推荐和解释。

- RecMind:基于ChatGPT API构建,包含工具、规划等组件,可处理多种推荐任务。

-

-

LLM在推荐系统中的应用分类:从训练和推理阶段出发,分为四个象限。相对较小的PLM用于语义特征提取,搭配传统推荐模型;利用LLM的zero-shot能力直接推荐,但效果一般;使用更大的语言模型,具备更多功能;通过对LLM的推荐数据训练解决专业知识问题 。

-

业界应用尝试:在电商推荐系统中,利用大模型进行类目挖掘、商品文本语义表征和长文档推荐。尝试多种模型后选用通义千问,通过基于文本相关性的向量召回和站内后验统计的query2cate映射,实现LLM搭配类目到站内ID的映射。

-

挑战与展望:LLM在推荐系统应用中面临训练和推理性能问题,如GPU资源用量大、训练时间长、推理时延高;ID-index与语言模型融合困难;存在模型偏见、安全和幻觉等问题。未来可通过PEFT、蒸馏等技术优化性能,探索新推荐范式和ID索引策略,解决模型相关问题。

| 应用分类 | 具体任务 | 模型名称 | 主要特点 |

|---|---|---|---|

| 候选打分任务 | RecFormer | 用自然语言建模,4种Embedding,两种预训练任务,两阶段微调 | |

| TALLRec | 用推荐数据微调LLM,分两步提升效果 | ||

| Prompt4N | 设计多种模板将新闻推荐转MLM任务 | ||

| 候选生成任务 | ChatGPT-based Generation | 利用zero-shot能力,多种prompt方式 | |

| PALR | 微调LLaMA-7B,两种任务设置 | ||

| 混合任务 | ChatGPT | 通过prompt用于多种任务,不同任务表现不同 | |

| P5 | 统一推荐任务范式,seq2seq框架预训练 | ||

| M6-Rec | 类似P5,用M6模型,优化性能延迟 | ||

| 流程控制 | Chat-REC | 输入多种信息,可调用传统推荐接口 | |

| RecLLM | 多模块协作,用LLM对话、检索、推荐和解释 | ||

| RecMind | 基于ChatGPT API,多组件处理推荐任务 |

关键问题

-

TALLRec模型中alpaca-tuning和rec-tuning分别起到什么作用?

- alpaca-tuning是对基座模型LLaMA进行适当的Instruct-tuning,能明显提升模型效果;rec-tuning则是引入推荐数据进行微调,让模型更适应推荐任务,两者结合使TALLRec在推荐任务上AUC最高。

-

与其他候选生成模型相比,PALR模型微调LLaMA-7B的优势是什么?

- PALR通过微调LLaMA-7B,设置特定的推荐任务,如Recommend和Recommend_Retrieval,使模型能学习推荐专业领域知识,相比利用LLM zero-shot能力直接推荐的模型,效果更好,能更精准地生成推荐结果。

-

LLM在电商推荐系统应用中,选择通义千问模型的依据是什么?

- 文中尝试过LLaMA、ChatGlm6B、通义千问、百川13B、chatgpt等模型,最终选用通义千问,但未明确给出具体依据。推测可能是通义千问在类目挖掘、商品文本语义表征等任务上,综合性能、效果、成本等因素表现更优,能更好地满足电商推荐系统需求。